在机器学习领域,模型的预测能力日益强大,但其背后的决策过程却常常被视为一个黑盒子。在这种情况下,我们往往需要一种强大的工具来解释模型预测的逻辑和原因。SHAP(SHapley Additive exPlanations)作为一种解释机器学习模型预测的工具,正是为了解决这个问题而诞生。SHAP以其独特的理论基础和计算方法,为我们提供了一种清晰、直观的方式来解释模型的预测结果。本文将深入探讨SHAP的原理、应用范围、解释能力以及使用中的注意事项,让我们一起揭开机器学习模型预测背后的神秘面纱。

在机器学习领域,了解模型背后的决策逻辑一直是个难题。模型的预测能力通常强大,但却缺乏解释性。SHAP(SHapley Additive exPlanations)作为一种解释机器学习模型预测的工具,正为这一挑战提供了解决方案。

SHAP简介

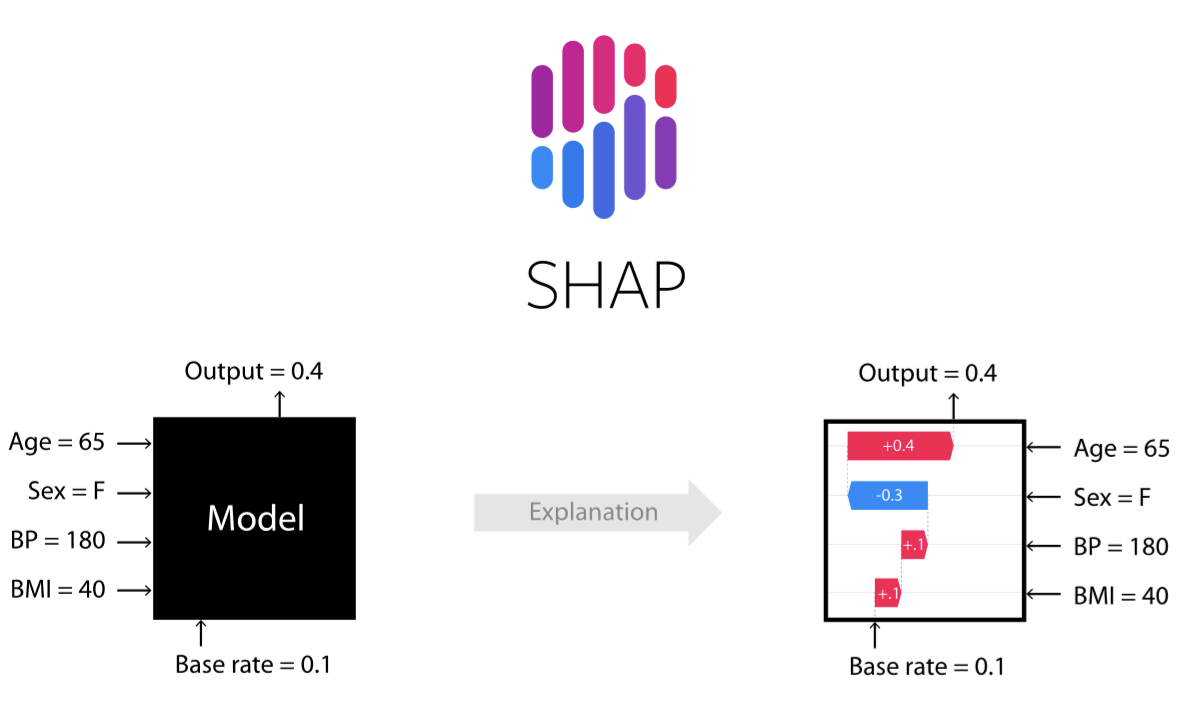

SHAP是一个基于Shapley值理论的Python库,用于解释机器学习模型的预测。它提供了一种清晰、直观的方式来解释模型的预测结果,特别是对于深度学习等复杂模型而言。

SHAP的特点

- Shapley值理论支持:基于合作博弈理论中的Shapley值,提供了一个严谨的数学框架,用于量化每个特征对模型预测的贡献程度。

- 清晰直观的解释:提供了直观的特征重要性排序,通过图形化展示每个特征对模型预测的影响,帮助用户更直观地理解模型的特征依赖性。

- 支持多种模型:适用于各种机器学习模型,包括树模型(如XGBoost、LightGBM)、线性模型和神经网络等,为不同类型的模型提供解释能力。

- 图形化展示特征影响:以图形化方式展示特征对模型预测的重要性排序,让用户更容易理解不同特征的影响程度及模型预测的依赖关系。

- 适用于复杂模型:在解释深度学习等复杂模型方面表现出色,能够帮助解释这些高度非线性的模型。

- 处理高维数据:对于高维数据和复杂模型,虽然计算量较大,但提供了一种可行的方式来解释模型的预测结果。

- 为特征工程和决策提供支持:SHAP提供的特征重要性排名为特征工程和模型改进提供了重要的参考依据,帮助进行更好的特征选择和优化模型。

应用领域

- 医疗健康:在医疗领域,解释模型对患者病情预测的原因,帮助医生理解模型的推荐或预测。

- 金融业务: 对贷款预测等金融领域的模型进行解释,为信贷决策提供支持和解释。

- 工业制造:解释模型对产品质量预测的原因,帮助优化生产流程和改进产品质量。

- 教学和研究:作为教学工具,帮助学生理解机器学习模型预测的解释性和可解释性。

总结

SHAP的出现为解释机器学习模型预测提供了新的视角。它不仅让我们能够更深入地了解模型的预测过程,还为特征工程、模型改进和决策制定提供了重要的参考依据。通过SHAP,我们能够更直观、更深入地理解模型背后的逻辑,这为我们带来了更多发现和创新的机会。让我们继续探索、利用SHAP这一有力工具,提高我们对机器学习模型预测的解释和理解能力,为数据科学的发展贡献自己的一份力量。

如果你对编程知识和相关职业感兴趣,欢迎访问编程狮官网(https://www.w3cschool.cn/)。在编程狮,我们提供广泛的技术教程、文章和资源,帮助你在技术领域不断成长。无论你是刚刚起步还是已经拥有多年经验,我们都有适合你的内容,助你取得成功。

免费 AI IDE

免费 AI IDE